About

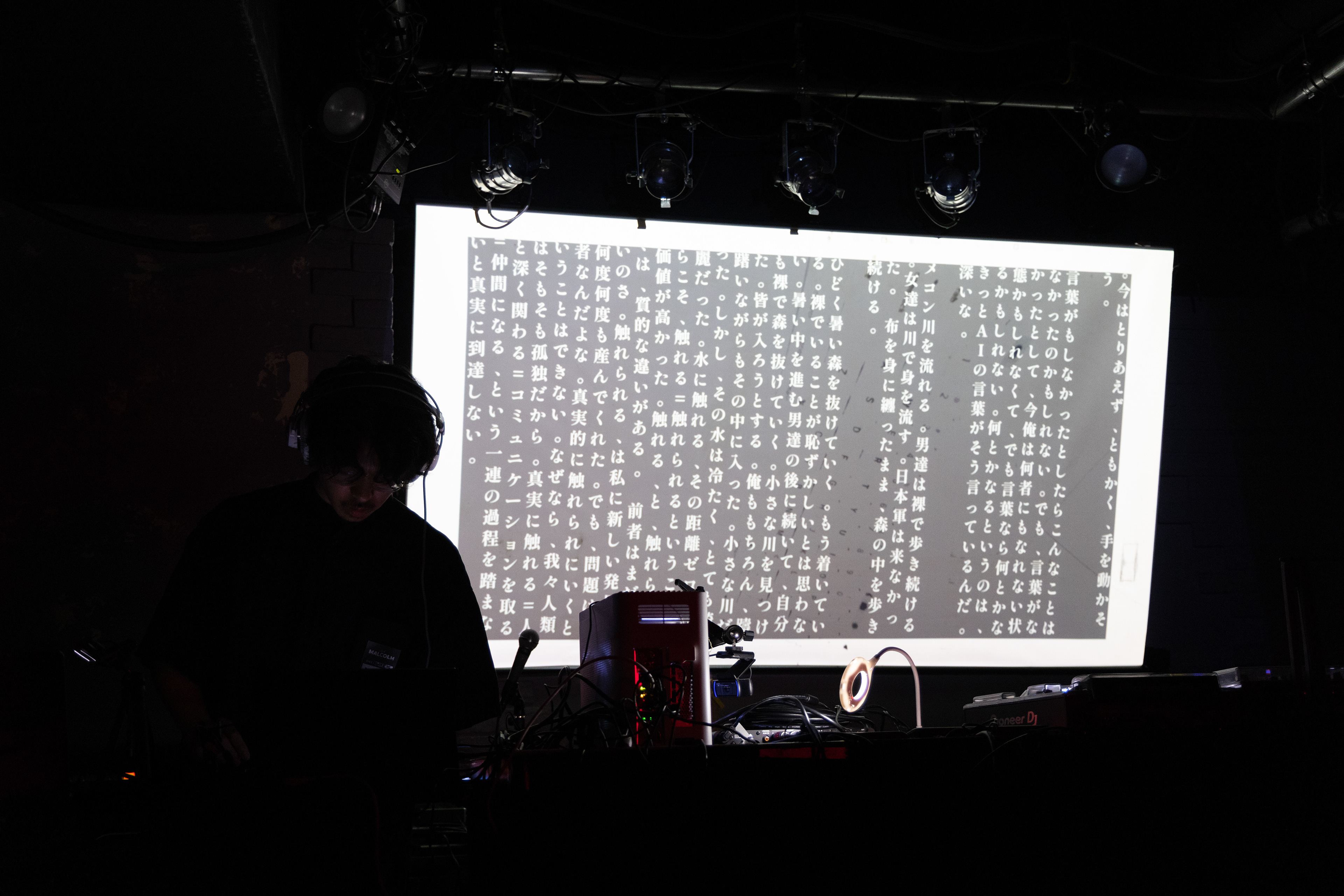

A performance in which the AI that has learned my four-year diary and I write today's diary entry line by line and recite it aloud. While I read aloud the diary I am writing, the weak electromagnetic waves emitted by the GPU during the inference of the diary by the AI are amplified and converted into noise, which is then played as the voice of the computer. From the middle of the performance onwards, the voice of the computer is input into the speech conversion AI model that has learned my voice, and the noise gradually approaches my voice quality.

私の4 年間分の日記を学習した文章生成AIと私が、1 行ずつ今日の日記を書き、声に出して詠むパフォーマンス。 私は自身が書いている日記を声に出して詠む一方、AI による日記の推論中に発せられるGPUの微弱な電磁波を増幅させてノイズ音に変換し計算機の声として鳴らす。パフォーマンス中盤以降、計算機の声は、私の声を学習した音声変換AI モデルに入力され、ノイズが徐々に私の声質に近づいて いく。

Work

In this work I provided direction, wrote the paper, concept, finger state monitoring using infrared sensors, computed camera information, and implemented the state machine.

文章生成AIである日本語版GPT-2を自分の日記を用いてファインチューニングし、対話相手としました。RVC という音声変換モデルを利用し、PythonからAbleton Liveに音をリアルタイムで送信しています。また、AI が推論を行う主要な部品であるGPUから発せられる電磁波を自作のコイルで増幅させ、音声変換モデルの入力として利用しています。

Award / Exhibition / Conference

・[Liveset] MOMENTUM audio visual event (2023.8.25 at Club Malcolm)

Asuka Ishii